(泉源:由 AI 生成的图片)

随着ChatGPT引发新一轮人工智能(AI)热潮,而其背后带来的能耗问题也连续引发关注。

本年4月10日,芯片巨头 Arm公司CEO哈斯(Rene Haas)公开表现,包罗ChatGPT在内的 AI 大模型需要大量算力,预计到2030年,AI 数据中心将消耗美国20%至25%的电力需求,相比本日的4%大幅增加。

公开数据显示,目前,ChatGPT天天需要处置惩罚凌驾2亿次请求,其电量消耗高达天天50万千瓦时。一年时间,ChatGPT光电费就要花2亿元人民币。

这意味着,ChatGPT日耗电量是普通家庭的1.7万倍以上。(美国商业用电一度约为0.147美元也就是1.06元,相当于一天53万元)

据荷兰咨询机构负责人Alex de Vries预计,到2027年,AI 行业每年将消耗850亿~1340亿千瓦时的电力,相当于瑞典或荷兰一个欧洲国家一年的总用电量。

马斯克判断,电力缺口最早大概会在2025年发生,“明年你会看到,昨们没有足够电力来运行所有的芯片”。

OpenAI CEO奥尔特曼(Sam Altman)也预计,AI 行业正在走向能源危机,未来 AI 技能发展将高度依赖于能源,人们也需要更多的光伏和储能产物。

这一切都显示出,AI 即将引爆全球新一轮“能源战争”。

不止是芯片,AI 还被能源“卡脖子”

已往500多天里,ChatGPT引发全球新一轮 AI 大模型和算力需求热潮。

微软、谷歌、Meta、OpenAI等多家全球科技巨头开始疯抢 AI 芯片,甚至亲自下场“造芯”,总规模凌驾数十万亿元美金。

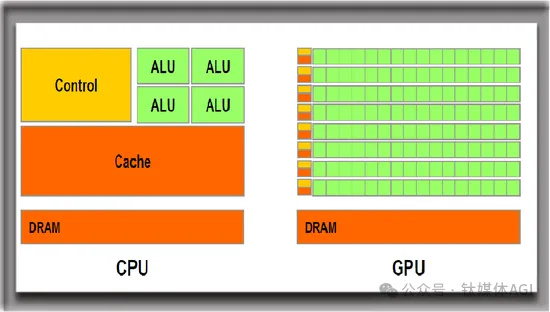

实际上,AI 本质上是一种盘算机技能和处置惩罚信息的技能,背后则需要大量GPU芯片,更底层则是大量电能、水力、风能、资金等资源的支持。

早在1961年,在IBM公司工作的物理学家拉尔夫·兰道尔(Rolf Landauer)发表了一篇论文,提出了厥后被称为“兰道尔原理”(Landauer's Principle)的理论。

这一理论认为,盘算机中存储的信息发生不可逆的变革时,会向周围情况散发一点点热量,其散发的热量和盘算机其时所处的温度有关——温度越高,散发的热量越多。

兰道尔原理毗连起了信息和能量。更详细地说,它毗连到了热力学第二定律上。因为逻辑上不可逆的信息处置惩罚操纵,也就意味着湮灭了信息,这会导致物理世界中熵的增加,从而消耗能量。

这一原理自提出以来遭受过不少质疑。但近十几年来,“兰道尔原理”已被实验证明。

2012年,《自然》杂志发表了一篇文章,研究团队首次丈量到了一“位”(bit)数据被删除时释放的微量热量。厥后的频频独立实验,也都证明了“兰道尔原理”。

已往10多年间,现代电子盘算机在盘算时实际消耗的能量,是兰道尔理论值的数亿倍。而科学家们一直在努力寻找更高效的盘算方法,以低落本钱。

如今,AI 大模型发作,它确实需要大量盘算。因此,AI 不止被芯片“卡脖子”,还被能源“卡脖子”。

马斯克近期也在“博世互联世界2024”大会上表现,一年多以前,短缺的是芯片,明年你会看到电力短缺,无法满意所有芯片的需求。

中国科学技能信息研究所人工智能中心副主任李修全也表现,比年来, AI 大模型规模、数量都在高速增长,也带来对能源需求的快速增加。只管短期内还不会很快出现“缺电”等问题,但未来大规模智能化时代到临后的能源需求激增不容忽视。

AI 大模型质量的关键在于数据、算力和顶尖人才,而高算力的背后,是靠着数万张芯片昼夜不绝的运转支撑。

详细来说,AI 模型算力的工作过程大抵可以分为训练、推理两个阶段,能源消耗也是如此。

其中,在AI训练阶段,首先需要收集和预处置惩罚大量的文本数据,用作输入数据;其次,在适当的模型架构中初始化模型参数,处置惩罚输入的数据,实验生成输出;最后,通过输出与预想之间的差别反复调解参数,直到模型的性能不再显著提高为止。

从训练15亿参数的GPT-2,到训练1750亿参数的GPT-3,OpenAI模型背后的训练能耗十分惊人。公开信息称,OpenAI 每训练一次需要128.7度电,相当于 3000 辆特斯拉同时跑 32 公里。

据研究机构New Street Research估计,仅在AI方面,谷歌就需要约莫40万台服务器,天天消耗62.4吉瓦时,每年消耗22.8太瓦时的能源。

而在推理阶段,AI 则会先加载已经训练好的模型参数,预处置惩罚需要推理的文本数据,再让模型根据学习到的语言规律生成输出。谷歌称,从2019年到 2021年,AI相关能源消耗60%都来自推理。

据Alex de Vries估算,ChatGPT天天大概要响应约莫2亿个请求,耗电量凌驾50万度,按照一年电费就是2亿元人民币,比每个美国家庭的平均日用电量高1.7倍。

SemiAnalysis陈诉称,使用大模型举行问题搜索所消耗的能源是通例关键词搜索的10倍。以谷歌为例,尺度谷歌搜索使用0.3Wh电力,而大模型每次互动的耗电量为3Wh。如果用户每次在谷歌搜索都使用AI工具,每年约莫需要29.2太瓦时的电力,也就是天天约7900万度。这相当于给全球最大的摩天大楼,迪拜的哈利法塔,一连供电凌驾300年。

另据斯坦福人工智能研究所发布的《2023年 AI 指数陈诉》显示,每次 AI 搜索的耗电量约莫为8.9瓦时。相比普通谷歌搜索,参加 AI 的单次耗电量险些是一般搜索的30倍。而一个高达1760亿参数的模型,光是前期训练阶段就得用掉了43.3 万度电,相当于美国117个家庭一年的用电量。

值得注意的是,在Scaling Law(缩放规律)之中,随着参数规模不停跃升,大模型性能也不停提升,而对应的是,能耗也会越来越高。

因此,能源问题已经成为 AI 技能连续发展的关键“桎梏”。

GPT天天消耗50000升水,电和水是 AI 两大能源需求

AI不但是“耗电狂魔”,更是“吞水巨兽”。

其中,在电力方面,除了上述信息外,据国际能源署(IEA)数据显示,2022年,全球数据中心消耗约460太瓦时的电量(相当于全球总需求的2%),随着生成式AI飞速发展,这一数字到2026年大概膨胀至620至1050太瓦时。

Alex de Vries预计,到2027年,AI服务器所消耗的用电量将等同于荷兰全国的能源需求量。最坏的情况就是,仅谷歌一家公司的AI就可以消耗与爱尔兰等国家一样多的电力。

IBM高级副总裁达里奥·吉尔曾表现,“AI能耗”是非常重要的挑战。生成式 AI 的高性能服务器的连续运行,将导致数据中心一半以上的电力消耗都被AI占据。据悉,预计到2025年,AI 业务在全球数据中心用电量中的占比将从2%猛增到10%。

那么,水能呢?大模型背后需要数据中心、云底子设施的支持,那就需要大量的“液冷”举行散热。

得克萨斯大学的一份研究指出,作为ChatGPT背后的重要支持气力,微软的Microsoft Azure云数据中心光是训练GPT-3,15天就用掉快要70万升的水,相当于天天花销约50000L水。

同时,ChatGPT每答复50个问题就要消耗500毫升水。公开信息称,2022年微软用水量到达640万立方米,比2500个奥林匹克尺度游泳池的水量还多。

美国加州大学河滨分校副传授任绍磊团队预计,到2027年,全球AI大概需要4.2-66亿立方米的清洁淡水量,这比4-6个丹麦、或二分之一的英国的一年取水总量还要多。

除了数据中心,内置的GPU芯片也是能源消耗的重点范畴之一。本年3月,英伟达发布史上性能最强AI芯片——Blackwell GB200,宣称是A100/H100系列AI GPU的继任者,性能相比H100提升30倍,但能耗却低落了25倍。

上个月,黄仁勋的一句“AI的止境是光伏和储能”更是在网络疯传。只管有网友扒出原视频称,黄仁勋本人并未说过这句话,更没有提及“光伏和能源”,但 AI 能耗严重,却是摆在公众眼前的事实。

国际能源机构(IEA)在一份陈诉中强调了这个问题,全球 AI 数据中心的耗电量将是 2022 年的十倍,并指出部门原因在于 ChatGPT 这样的大模型所需的电力,远高于谷歌等传统搜索引擎。

不外,值得注意的是,由于科技巨头们并未正式披露过 AI 使用中的电力消耗数据,因此,目前关于 AI 耗电量的数据多为估算,并不一定是非常准确的数据。美国信息技能与创新基金会(ITIF)曾指出,个别禁绝确的研究高估了AI能耗。AI训练是一次性事件,它的使用是恒久过程。人们应关注 AI 能耗的恒久影响,并非发作式增长。

有专家认为,目前大模型训练本钱中60%是电费,能源开支已经严重制约着大模型的迭代升级。

金沙江创投主管合资人朱啸虎克日也表现,可控核聚变实现前,昨们并没有足够的算力实现真正的AGI。帮人类低落90%的工作大概未来3到5年可以实现,但最后的10%大概需要大量的算力和能耗。

如何办理 AI 能耗之困?硬件优化和核聚变或是重要手段

虽然黄仁勋也非常担心能源供给,但他却给出了一个更乐观的见解:已往10年,AI 盘算提高了100万倍,而它消耗的本钱、空间或能源并未增长100万倍。

美国能源情报署发布的恒久年度展望中估计,美国目前电力需求的年增长率不到1%。而按新能源公司NextEra Energy CEO约翰•凯彻姆(John Ketchum)的估计,在 AI 技能的影响下,这一电力需求年增长率将加速至1.8%左右。

波士顿咨询团体的陈诉则显示,2022年,数据中心用电量占美国总用电量(约130太瓦时)的 2.5%,预计到2030年将增加两倍,到达7.5%(约390太瓦时)。这相当于约4000万个美国家庭的用电量,即全美三分之一家庭的用电量。该团体还预计,生成式 AI 将至少占美国新增用电量的1%。

这意味着,纵然数据中心、AI 新增用电量并不小,但还远不到毁天灭地的田地。

而在本钱方面,国际可再生能源署陈诉指出,已往十年间,全球风电和光伏发电项目平均度电成天职别累计下降凌驾了60%和80%。上述业界人士也先容说,“光伏的综合本钱跟火电差不多,风电一半区域的综合本钱比火电低了。”

因此,随着 AI 技能一路狂飙,昨们又将如何应对即将到来的能源需求热潮?

钛媒体App根据一些行业专家的观点总结来看,目前办理 AI 能耗问题有两种方案:一是可以通过大模型或AI硬件优化低落能耗;二是寻找新的能源,好比核聚变、裂变资源等,以满意AI能耗需求。

其中,在硬件优化方面,对于能耗较高的万亿级 AI 大模型,可以通过算法和模型优化,压缩模型token巨细及复杂度,以低落能源消耗规模;同时,企业也可以连续开辟和更新能耗更低的 AI 硬件,如最新的英伟达B200,AI PC或AI Phone终端等;别的,通过优化数据中心的能效,提高电源使用效率,以低落能源消耗。

对此,中国企业资本同盟副理事长柏文喜表现,未来,还需要举行技能创新和设备升级,以进一步提高发电效率、提高电网输送能力和稳定性、优化电力资源配置、提高电力供应的机动性、推广分布式能源系统并淘汰能源输送损耗,以此来应对算力发展带来的能源需求挑战。

中国数据中心工作组(CDCC)专家委员会副主任曲海峰认为,相关行业应该要重视提升数据中心用电能效,而不是抑制它的规模。数据中心并非要淘汰对能源的消耗,而是要提升能源消费的质量。

而在开辟核聚变能源方面,由于可控核聚变由于原料资源丰富、释放能量大、安全清洁、环保等优势,能根本满意人类对于未来抱负终极能源的各种要求。

核聚变的能量泉源目前主要有三种:宇宙能源,即太阳发光发热;氢弹爆炸(不受控核聚变);人造太阳(受控核聚变能源装置)。

据统计,当前世界共有50多个国家正在举行140余项核聚变装置的研发和建立,并取得一系列技能突破,IAEA预计到2050年世界第一座核聚变发电厂有望建成并投入运行。

这种核聚变发电,将大大缓解全球因 AI 大模型需求造成的能源短缺情况。

2023年4月,奥尔特曼就“未雨绸缪”,以个人名义向核聚变初创公司Helion Energy投资3.75亿美元(约合人民币27.04亿元),并担当公司董事长。同时,去年7月,奥特特曼还通过旗下公司AltC与其投资的核裂变初创公司Oklo归并,斩获了一个估值约为8.5亿美元(约合人民币61.29亿元)的IPO,ALCC最新市值凌驾400亿美元。

除了奥尔特曼这种重金投资核聚变公司,亚马逊、谷歌等科技巨头则直接大手笔采购清洁能源。

据彭博数据显示,仅在2023年,亚马逊就购买了8.8GW(吉瓦)的清洁能源电力,已经一连第 4 年成为全球最大的企业清洁能源买家。Meta(采购3GW)和谷歌(采购1GW)等科技公司则位列其后。

亚马逊称,其90%以上的数据中心电力都泉源于清洁能源产生的电力,预计能在2025年实现100%使用绿色电力。

实际上,以美国为例。清洁能源、AI、数据中心、电动汽车、挖矿等多种财产的增长,让原本陷入停滞的美国电力需求再度“起飞”。但纵然被誉为世界上“最大的呆板”,美国电网也似乎无法应对这突如其来的变革。

有分析师指出,美国70%的电网接入和输配电设施已老化,某些地域电网传输线路不敷。因此,美国电网需要大规模升级,如果不接纳行动,到2030年美国将面对一道难以逾越的国内供应缺口。

相对于美国,中国则对能源需求表达乐观态度。“AI再耗电,中国的体量和能力足以支撑,现在不举行大规模开辟,是因为没需求。”一位风电行业人士表现,中国可规划的容量足够大,AI要是有大量电力需求,我现在就能上项目当中去工作。

目前,中国风电、光伏产物已经出口到全球200多个国家和地域,累计出口额分别凌驾334亿美元和2453亿美元。

随着 AI 出现发作式增长,这场中美 AI 财产比赛,已经从大模型技能比拼,升级成为一场算力、能源、人力等多方位争夺战。

随着核聚变能源或将到2050年落地,人类期望终结 AI 能耗这一具有挑战性难题,进入无限发电时代。

(本文首发钛媒体App,作者|林志佳。张盈对本文亦有贡献)