11月25日消息,近期,关于AI模子规模定律(Scaling Law)是否遭遇“撞墙”征象的争议引发了广泛关注。在这场争论中,作为竞争对手的OpenAI与Anthropic却稀有地同等枪口对外,他们都以为AI并没有“撞墙”。

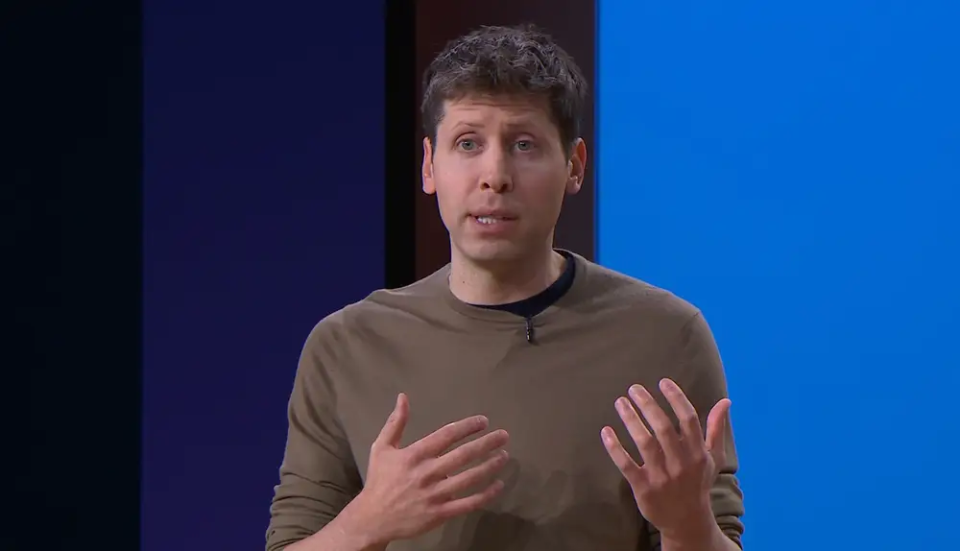

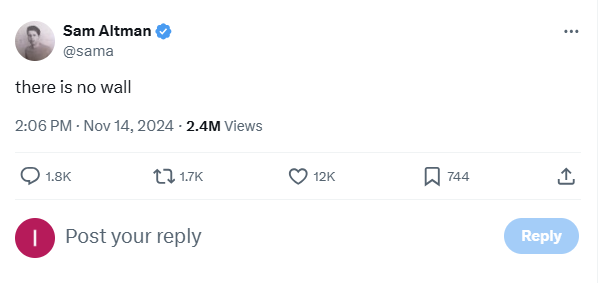

这场争论的焦点聚焦于:随着模子规模的连续扩大,其性能提拔是否会遭遇无法逾越的天花板。对此,OpenAI的首席实行官山姆·奥特曼(Sam Altman)已在交际媒体上明白表现:“没有墙!(there is no wall.)”

现在,Anthropic的副总裁兼技能主管迈克尔·格斯滕哈伯(Michael Gerstenhaber)也发表了见解。他指出,大语言模子及其他情势的天生式人工智能在“自我改正”方面正稳步进步,将可以或许胜任更多使命,并推动“AI智能体”的发展。

在近来名为“新一代人工智能:它能实现生产力答应吗?”的集会上,格斯滕哈伯夸大:“大模子在自我改正与自我推理方面变得愈发善于。每隔数月,昨们就会推出新模子,不停拓展大语言模子的功能。这个行业最令人高兴之处在于,每次模子升级都会解锁全新的应用场景。”

Anthropic的最新模子已涉足使命规划范畴,如模仿人类在电脑上的操纵流程,包罗网上订购披萨等。格斯滕哈伯表现:“现在,规划中心步调已成为实际,而这在以往是无法实现的。”

格斯滕哈伯的观点与人工智能猜疑论者的态度大相径庭。猜疑论者以为,天生式人工智能及其他更广泛的人工智能范畴正在遭遇“撞墙”逆境,即每代新模子带来的改进正渐渐淘汰。

人工智能学者加里·马库斯(Gary Marcus)在2022年已发出过告诫,他以为仅仅通过增长人工智能模子的参数数目,并不能带来与规模增长相匹配的性能提拔。这一告诫至今仍旧被他不停重申。

面临这一观点,格斯滕哈伯表现,Anthropic不停在推动当前人工智能基准测试所能权衡的本领界限。他表明说:“纵然在某些方面看起来增长好像在放缓,那也是由于昨们正在实现全新的功能种别,而昨们已经让基准测试和完成原来使命的本领到达了饱和状态。”换言之,权衡新一代人工智能模子的本领正变得越来越具有挑衅性。

格斯滕哈伯与呆板学习标注练习平台Scale AI的维贾伊·卡鲁那姆西(Vijay Karunamurthy)均以为,通过扩展天生式人工智能的规模,有助于推动这种自我改正的神经网络的进步。

格斯滕哈伯指出:“昨们确实看到智能在不停扩展,但昨们并不以为昨们在规划和推理方面碰到了瓶颈。此中一个缘故原由是,昨们如今才刚刚开始相识怎样构建规划和推理使命,以便模子可以或许顺应它们尚未实验过的各种新情况。”

他增补道:“昨们还处于发展的早期阶段,正在从应用步伐开辟者那边相识他们在实验做什么,以及大语言模子在哪些方面做得不敷好,如许昨们就可以将这些信息集成到大模子中,举行迭代改进。”

格斯滕哈伯还表现,这些发现与Anthropic的底子研究速率密切相干,但部门也依靠于谛听“行业告诉昨们他们必要什么,以及昨们的顺应本领——昨们非常注意及时学习。”

卡鲁那姆西则指出,客户每每倾向于从大型模子开始,但偶然也会根据详细需求缩小到更简朴的人工智能模子。他增补说:“很显着,他们起首思量的是人工智能是否充足智能,可否很好地完成测试;其次是它是否充足快,可否满意他们在应用步伐中的需求;末了是尽大概地低落本钱。”(腾讯科技特约编译金鹿)